Infrastructuurlimieten en de druk om rendement te leveren

De werkelijke onderliggende beperking is infrastructuur, gecombineerd met de noodzaak om een rendement op geïnvesteerd kapitaal te leveren. Anthropic stelt de toegangsprijs voor Mythos op ongeveer vijf keer het niveau van Opus 4.6, het meest krachtige publiek beschikbare model. Een duidelijk signaal dat de meest geavanceerde AI een schaars goed wordt, waarbij zowel de prijs als de toegang steeds exclusiever worden.

Servers naderen hun limieten, gedreven door de opkomst van agentische AI. Taalmodellen voeren nu taken uit, schrijven code, beoordelen documenten en werken ononderbroken voor gebruikers. Dit leidt tot een grote en aanhoudende vraag naar rekenkracht op een schaal die niet was voorzien. Dit dwingt de markt tot een koerswijziging, en die is al zichtbaar in hoe AI geprijsd en aangeboden wordt.

Het einde van goedkope intelligentie

Het tijdperk waarin tokens werden gesubsidieerd door durfkapitaal loopt ten einde. Gartner schat dat tussen 2024 en 2029 6,3 biljoen dollar wordt geïnvesteerd in AI-datacenters. Dat kapitaal moet rendement opleveren.

De lat voor dat rendement ligt hoog. Om in lijn te blijven met wat Amazon, Microsoft en Google historisch gezien op hun kapitaal verdienen, moeten AI-aanbieders tegen 2029 ongeveer 8,2 biljoen dollar aan inkomsten genereren. Ongeveer 7 biljoen dollar is nodig om afschrijvingen te vermijden.

Weet je nog hoe goedkoop Uber was toen het uitkwam? Vergelijk dat met nu en je krijgt een idee van waar dit naartoe gaat.

Eerste signalen van een marktbrede prijsherziening

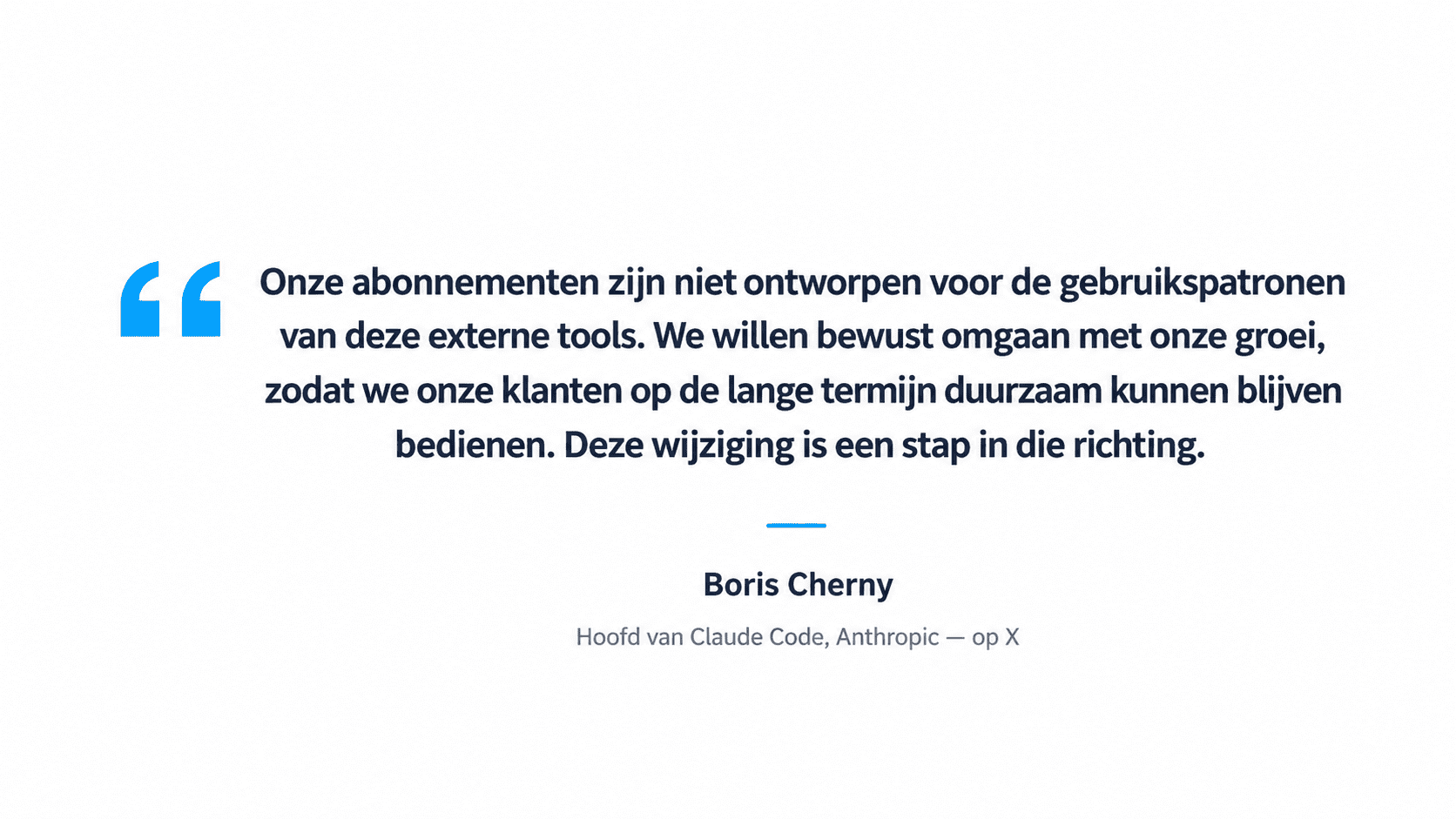

De eerste tekenen zijn al zichtbaar. GitHub heeft Copilot omgezet naar een gebruiksgebaseerd prijsmodel, waarbij de kosten direct gekoppeld zijn aan tokenverbruik. Anthropic stelde beperkingen in voor OpenClaw, een veelgebruikte AI-agenttool, en verhoogde de prijs voor toegang tot Claude. Andere aanbieders zullen volgen. Dezelfde economische druk geldt voor juridische AI, waar rekenintensieve workflows en groeiende adoptie directe druk uitoefenen op prijsstelling en marges.

Kostenbeheersing wordt een kerncompetentie in juridische AI

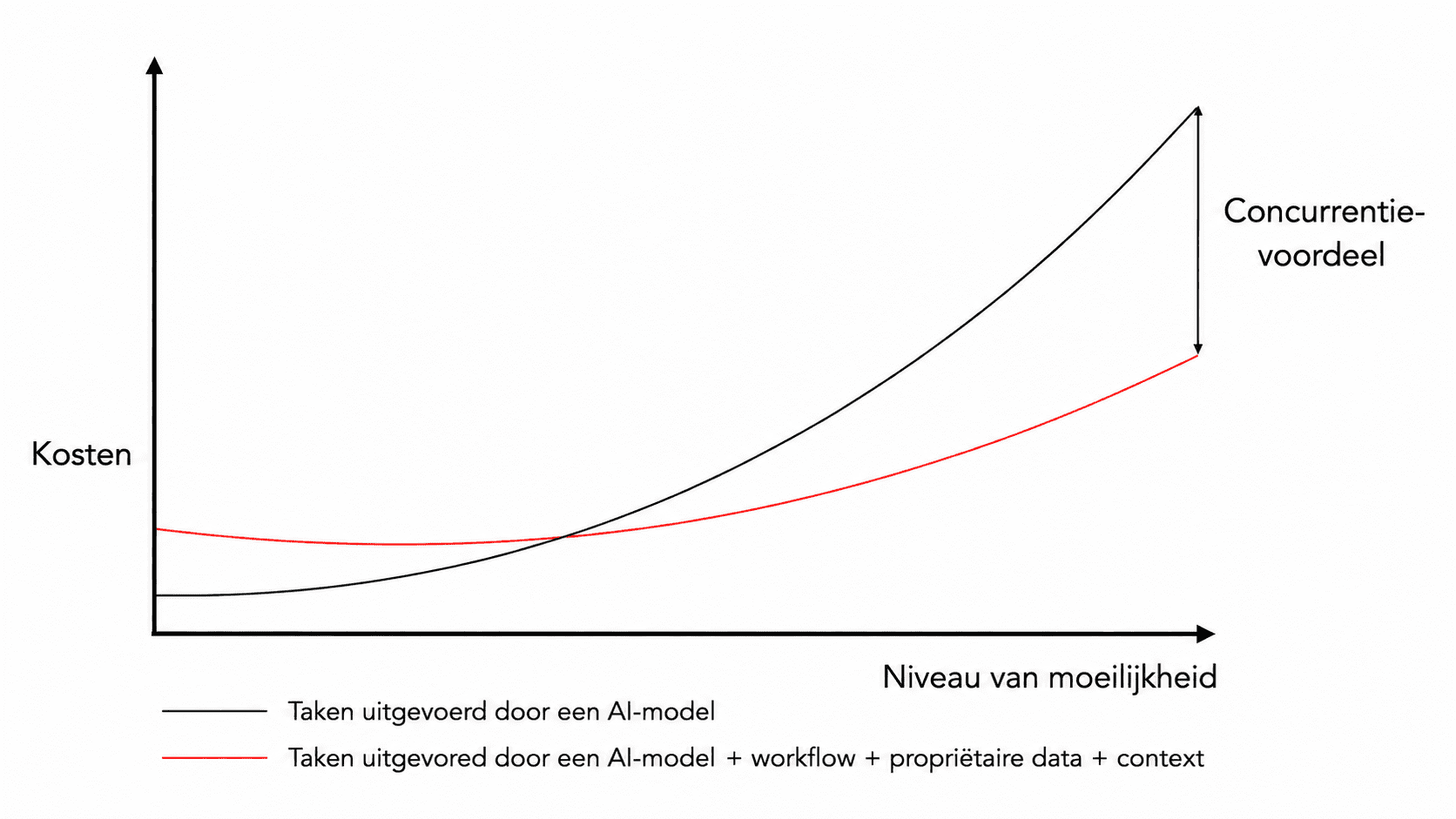

Voor juridische AI leidt dit tot een ander bedrijfsmodel. Aanbieders zullen een prijs per gebruiker gaan combineren met gebruiksgebaseerde prijsstelling. Dit maakt efficiënt tokengebruik voor juristen een kerncompetentie. Hoe je hierop moet reageren wordt duidelijk wanneer je kijkt naar hoe de rekenkosten toenemen naarmate de taken complexer worden (zie de grafiek hieronder).

De mate van investering in de structuur rondom je taalmodellen bepaalt je rekenkosten. Taken die worden uitgevoerd door een puur AI-model worden al snel duurder naarmate de complexiteit toeneemt. Complexere taken vragen om krachtigere modellen, meer rekentijd en hoger tokenverbruik. Maar wanneer workflows, interne data en context van tevoren zijn ingebouwd, vlakt de kostencurve af. Eenvoudigere modellen kunnen complexere taken aan, omdat een deel van het redeneerwerk al in het systeem is verankerd. Het verschil tussen deze benaderingen groeit naarmate de complexiteit toeneemt. En dat verschil bepaalt je concurrentievoordeel.

Hoe je met structuur de kosten van juridische AI beheerst

Laat me een voorbeeld geven. Stel dat je een aandeelhoudersovereenkomst opstelt. Een krachtig model kan een eerste versie genereren wanneer het voorzien wordt van voldoende kwalitatief goede voorbeelden en de juiste prompt. Het proces duurt ongeveer 20 minuten voor een document van 80 tot 100 pagina’s, met rekenkosten van ongeveer 20 dollar.

Een andere aanpak combineert beslisboomtechnologie met generatieve AI. De structuur van het document is vooraf bepaald, en het taalmodel krijgt een transcript van een vergadering met de oprichters over hoe zij willen samenwerken. Het model activeert de beslisboomsoftware om het document te genereren. Het resultaat wordt in seconden geproduceerd en de rekenkosten dalen naar centen. Een bijkomend voordeel is consistentie. Deterministische systemen produceren hetzelfde resultaat voor dezelfde invoer, waardoor de noodzaak vervalt om te controleren op hallucinaties of onvoorspelbare fouten.

Niet elke toepassing vereist deterministische AI. Documentbeoordeling kan worden afgehandeld door een capabel taalmodel gecombineerd met een goed ontworpen playbook, een gestructureerde set richtlijnen die bepaalt wat te accepteren, wat te markeren en waarom. Juridisch onderzoek kan steunen op een gestructureerde kennisbank met precedenten. Ik kan hier niet te diep op ingaan, maar het basisidee is om je juridische intelligentie vast te leggen en te structureren en beschikbaar te maken voor het taalmodel voor betere en betaalbare resultaten.

Lokaal draaien om kosten en data te beheersen

Naast het optimaliseren van hoe modellen worden gebruikt, is er ook de vraag waar ze worden uitgevoerd. Het lokaal draaien van open source modellen verandert de kostenstructuur fundamenteel. In plaats van per token te betalen aan een externe aanbieder, draait het model op je eigen hardware, waarbij de voornaamste kostendriver elektriciteit wordt. Of het model nu een minuut of urenlang draait, de kosten blijven laag.

Het biedt ook een sterk antwoord op gegevensgevoeligheid. Er verlaat geen data de omgeving waarin het model is geïmplementeerd, waardoor je volledige controle hebt over vertrouwelijkheid en compliance.

Er is een afweging. Lokaal geïmplementeerde modellen zijn over het algemeen kleiner en minder capabel dan de krachtigste modellen die via de cloud worden aangeboden. Zoals hierboven beschreven, maakt dit minder uit wanneer het omringende systeem goed is ontworpen. Structuur, context en workflows compenseren voor de modelomvang. Bovendien verbeteren open source modellen zich in rap tempo en volgen ze toonaangevende modellen doorgaans met slechts een paar maanden achterstand.

Het model is niet het concurrentievoordeel. Het systeem eromheen wel.

Je concurrentievoordeel komt niet voort uit toegang tot het krachtigste model, maar uit hoe effectief je het inzet. Kantoren die investeren in structuur, bewuste keuzes maken in modelgebruik en hun workflows daarop inrichten, werken sneller, tegen lagere kosten en met consistentere output. Dat is het fundament waarop de toekomst van juridische AI wordt gebouwd.