Na mijn vorige stuk, over generieke AI voor juristen, ontving ik best veel reacties. De tendens was steeds dezelfde: “Generieke AI is niet veilig, gebruik Legal AI.” Het is een begrijpelijke reactie, maar deze gaat voorbij aan een essentieel onderdeel van de technische infrastructuur: legal AI-tools draaien zelf ook op modellen van de grote AI-aanbieders. De vraag is dus niet óf je data door OpenAI of Anthropic verwerkt wordt, maar via hoeveel schakels, en op welk niveau is elke schakel beveiligd?

Omdat niet iedereen wellicht het einde van dit stuk haalt hier alvast de samenvatting in één zin: Legal AI kan zeker meerwaarde hebben. De meeste partijen nemen beveiliging zeer serieus, maar dit maakt hen niet per se veiliger dan de generieke leveranciers. Stel daarom de juiste vragen. Hoe ziet de keten eruit? Slaat de leverancier mijn data zelf op en zo ja, waar, hoe lang, door wie in te zien? Heeft de leverancier een enterprise-contract met de onderliggende aanbieder, of draait hij op standaard API-voorwaarden?

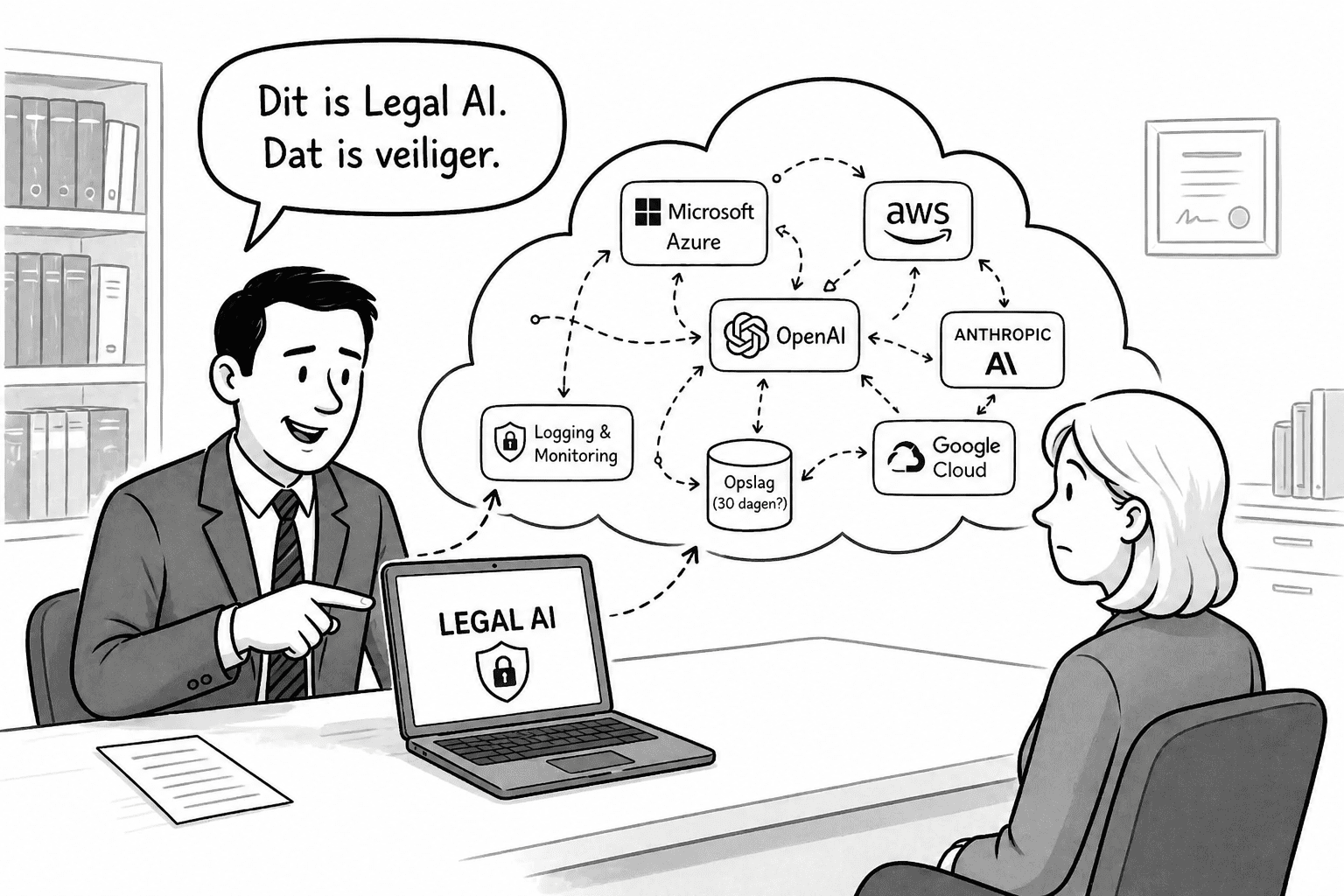

De keten die je niet ziet

Legal AI heeft uiteraard voordelen. Sommige tools bieden juridische workflows, slimme documentanalyse, rechtsgebiedspecifieke kennis. Maar het onderliggende taalmodel is vrijwel altijd van OpenAI, Anthropic of Google (zie ook ons onderzoek van vorig jaar: https://www.ictrecht.nl/onderzoek-ai-tooling-ictrecht). De leverancier bouwt een laag bovenop die modellen (zoals een interface, een set instructies, integraties met juridische databases), maar het afhandelen van jouw verzoek vindt uiteindelijk plaats bij dezelfde grote partij als wanneer je zelf een abonnement zou nemen.

De keten ziet er in de praktijk zo uit: jij stuurt een document naar de legal AI-tool, die tool stuurt het via een API door naar de onderliggende AI-aanbieder, die aanbieder verwerkt het en stuurt een antwoord terug. Dit betekent in de praktijk dat je een abonnement sluit bij een aanbieder van legal AI. Vervolgens stel je via dat platform een vraag of je start een workflow. Deze vraag wordt vervolgens naar een achterliggend taalmodel gestuurd (al dan niet via de servers van Microsoft) en deze stuurt het antwoord terug naar de tool waar je een abonnement hebt afgesloten.

Wat de grote aanbieders zelf bieden

Om die keten goed te beoordelen, is het nuttig te weten welke beveiligingsmaatregelen de grote aanbieders zelf hanteren en hoe dat verschilt per niveau.

Bij de gratis versies van tools als ChatGPT of Claude geldt standaard dat gesprekken gebruikt mogen worden voor modeltraining. Dat kun je uitzetten, maar je moet er actief voor kiezen. Hierin wil je liever geen persoonsgegevens of bedrijfsgegevens verwerken.

Maar op API-niveau (het niveau waarop legal AI-vendors doorgaans zijn aangesloten) liggen de afspraken al wezenlijk anders. Ten aanzien van de informatiebeveiliging en dataverwerking garanderen zowel Anthropic als OpenAI contractueel dat zij klantdata van de API niet gebruiken voor het trainen van modellen. Daarnaast beschikken zij over behoorlijk wat certificeringen:

Zo beschikt Anthropic voor haar API (maar ook bij gebruik binnen op servers van Microsoft, Amazon of Google) een SOC 2 Type 2, ISO 27001 en ISO 42001 certificaten. Dit is vergelijkbaar met OpenAI, ware het niet dat zij dit hebben aangevuld met ISO 27017 en ISO 27018.

Standaard wordt API-data dertig dagen bewaard (voor abuse monitoring), maar in overleg kan gekozen worden voor een zero data retention agreement en de data wordt direct na inferentie verwijderd. Ook is het mogelijk afspraken te maken over datalocatie, monitoring (wie er wanneer onder welke voorwaarden toegang heeft tot de logging) en verwerkersovereenkomsten.

Deze voorwaarden zijn eveneens van toepassing op de zakelijke varianten van Claude for Work en ChatGPT Enterprise.

Wat de schakel ertussen doet

En precies hier ontstaat de relevante vraag voor legal AI. Wanneer een vendor jouw data via de API doorstuurt, gelden in principe de API-voorwaarden van de onderliggende aanbieder.

Maar de leverancier verwerkt ook zelf data: in zijn applicatie, op zijn servers, in zijn logbestanden. Dat is een extra verwerkende partij met eigen beveiligingsvolwassenheid. En tenzij de leverancier aantoonbaar een enterprise-contract heeft afgesloten met de onderliggende aanbieder met EU-datalocatie zijn die enterprise-garanties niet automatisch van toepassing op jouw data.

Hoeveel beveiligingsvolwassenheid een legal AI-startup van twintig mensen heeft, en welke afspraken die precies heeft gemaakt met OpenAI of Anthropic, is doorgaans niet transparant gecommuniceerd. Dit is een korte weergave van de verschillende opties maar geeft een beeld van de architectuur en de mogelijkheden die er zijn.

Hoe zit het met de huis-tuin-en-keuken abonnementen

Nu zijn de enterprise licentie (natuurlijk) anders dan de betaalde consumentenlicenties. Bij deze abonnementen is terughoudendheid geboden. Hoewel bij een betaald abonnement standaard niet getraind wordt op jouw data, is er onvoldoende duidelijkheid over waar de data heen gestuurd wordt. Hoewel Anthropic en OpenAI op de website claimen dat ze ook voor deze abonnementen veilig omgaan met data en dit op een verantwoorde manier doen, ontbreekt hier aan concrete maatregelen die bij deze abonnementen horen.

Geen oordeel, wel vragen

Net als mijn vorige blog is dit geen pleidooi tegen legal AI. Gespecialiseerde tools kunnen een grote meerwaarde bieden en veel leveranciers nemen beveiliging serieus. Maar de aanname dat het label ‘legal AI’ automatisch meer veiligheid biedt dan de generieke oplossingen is niet juist.

De relevante vragen zijn simpel: welke AI-aanbieder verwerkt mijn data achter de schermen, en op welk contractniveau? Slaat de leverancier mijn data zelf op en zo ja, waar, hoe lang, door wie in te zien? Zijn er koppelingen met externe diensten die data kunnen doorsluizen? En heeft de leverancier een enterprise-contract met de onderliggende aanbieder, of draait hij op standaard API-voorwaarden?